Attention » Large Language Model(五)——AI agent, LLM实战

2025-09-12 :: 5675 WordsMoE(续)

Expert Parallelism

Expert-Parallel vs. Token-Parallel

MoBA:Mixture of Block Attention

https://github.com/deepseek-ai/DeepEP

deepseek官方的EP库

PPLXAll2AllManager是vLLM为了解决Expert Parallelism场景下MoE模型的跨GPU专家tensor交换,而引入的一个通信调度器(All-to-All管理器)。

DeepEPHTAll2AllManager和DeepEPLLAll2AllManager是vLLM在集成DeepEP(DeepSeek Expert Parallel)通信框架时,为MoE模型推理引入的两类分层All-to-All通信调度器。

它们把原来单一的All-to-All拆成两层:

- HT(High-Throughput)层——节点内GPU之间大批量、高吞吐交换;

- LL(Low-Latency)层——节点间跨机NVLink/IB网络低延迟交换。

EPLB:Expert parallelism load balancer

KTransformer

KTransformers由清华大学团队提出,可以在模型运行过程中灵活的将专家模型加载到CPU上,同时将MLA/KVCache卸载到GPU上,从而深度挖掘硬件性能,实现更低的显存运行更大尺寸的模型。

参考:

KTransformer部署高性能DeepSeek R1模型实战

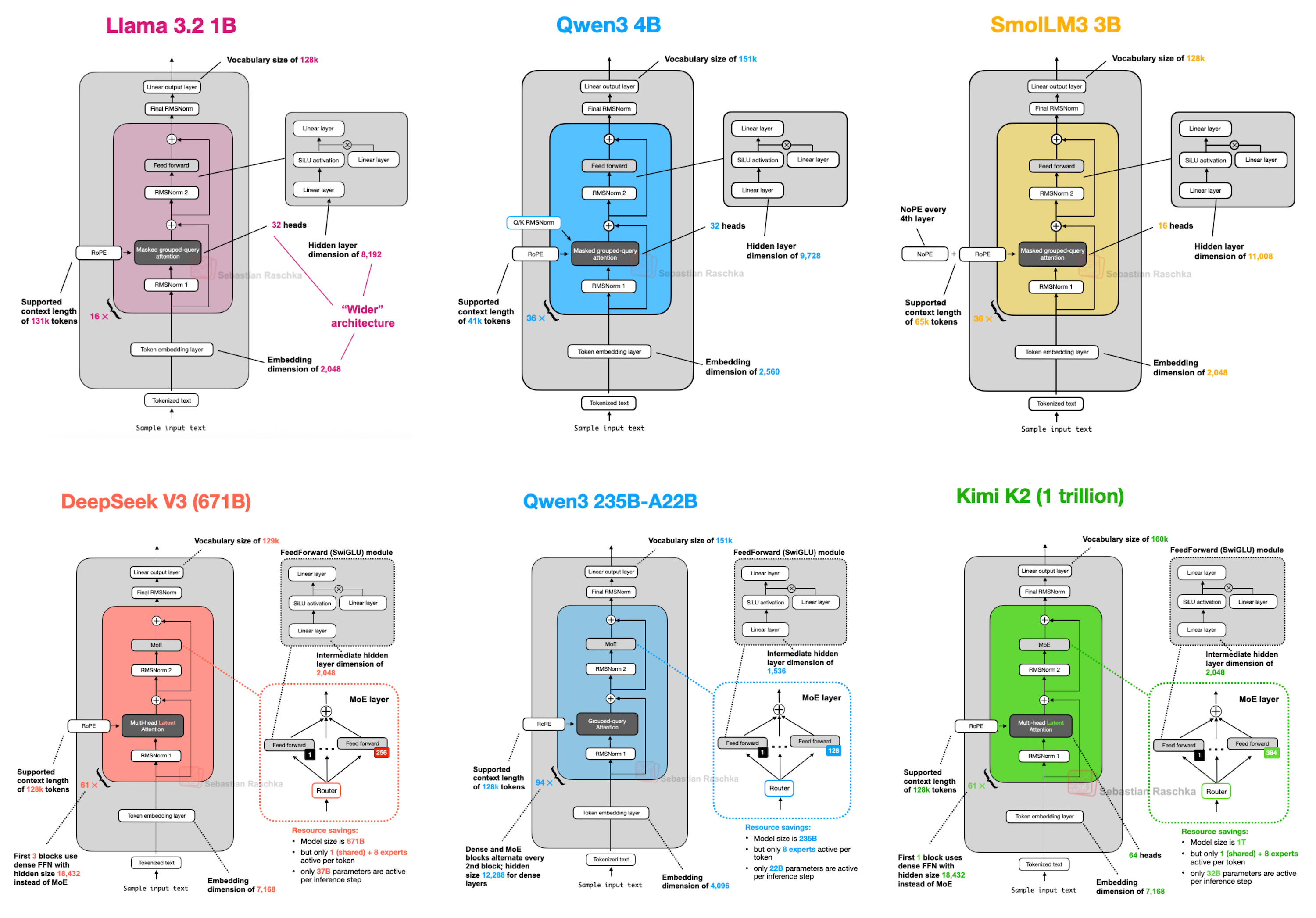

Kimi K2

上图来自:

https://sebastianraschka.com/blog/2025/the-big-llm-architecture-comparison.html

The Big LLM Architecture Comparison

https://sebastianraschka.com/llm-architecture-gallery/

更多LLM结构图

中文版:

https://zhuanlan.zhihu.com/p/1971937330051940822

2024-2025年开源LLM架构革新全览:MoE、注意力机制与归一化层的进化

官方技术报告:

https://moonshotai.github.io/Kimi-K2/

参考:

https://www.zhihu.com/question/1927140506573435010

Kimi发布首个万亿参数开源模型K2模型,哪些信息值得关注?

LLM应用

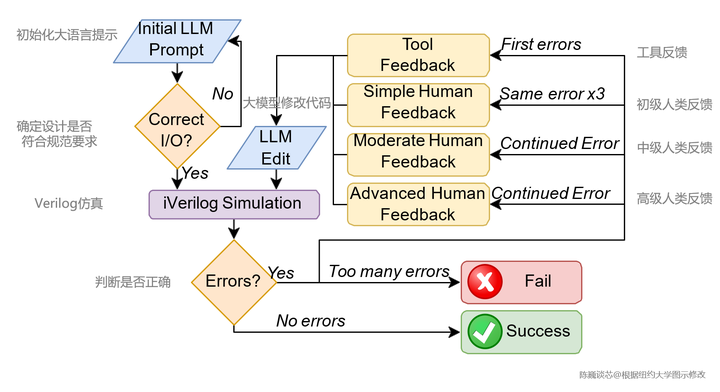

大语言模型参与的芯片前端设计迭代流程

Vibe Coding是一种2025年才出现、以AI为核心的全新软件开发方式:开发者不再逐行手写代码,而是用自然语言把“想要什么”告诉大模型,由AI生成、修改并反复迭代,直到“感觉对了”就上线——整个过程更像“对话+氛围感知”,而不是传统意义上的编码。

https://www.zhihu.com/question/1944542162130833916

什么是Vibe Coding?

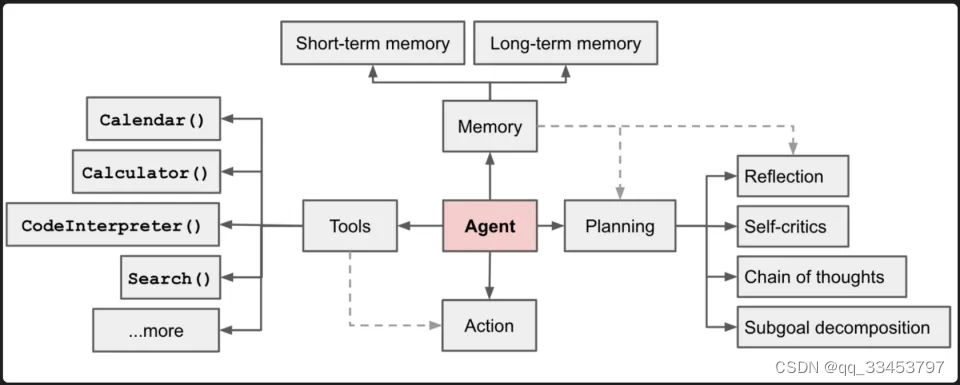

AI agent

AI agent本质上是一个构建在LLM(大模型)之上的智能应用,也就是说AI agent是大模型的上层应用。如果说把AI比做一个人,那么大模型就是这个人的大脑,虽然它拥有了智能,但其却没有能够真正做事的实体。而AI agent就相当于人的手脚眼睛和嘴巴,以及各种人类能够利用的工具。

https://blog.csdn.net/qq_33453797/article/details/138324548

爆火的AI Agent到底是什么?有了大模型为什么还需要AI Agent?

https://blog.csdn.net/v_JULY_v/article/details/135868163

智能体AI Agent的极速入门:从ReAct、AutoGPT到AutoGen、QwenAgent、XAgent、MetaGPT

https://blog.csdn.net/v_JULY_v/article/details/142796658

OmniH2O——通用灵巧且可全身远程操作并学习的人形机器人

https://blog.csdn.net/v_JULY_v/article/details/142769965

VLM驱动机器狗——从UMI on Legs到Helpful DoggyBot:分别把机械臂装到机器狗背上、夹爪装到机器狗嘴里

https://zhuanlan.zhihu.com/p/1917883331829273687

Devin炮轰Claude:别再搞Multi-Agent了

Prompt Engineering管的是”问什么”,Context Engineering管的是”给LLM看什么上下文”,而Harness Engineering管的是”整个运行环境怎么设计”——它是最上层的学科,前两者是它的子集。

在LLM(大语言模型)的语境中,”Harness” 是一个动词,意思是”驾驭、利用”,即充分利用和控制模型的能力。

https://zhuanlan.zhihu.com/p/2027834017840415550

AI真能自己写出整个Windows系统吗?我做了一场无监督实验

MCP(Model Context Protocol)由Anthropic于2024年11月推出,是一个开放标准协议,用于统一大模型与外部工具、数据源之间的交互方式。

https://zhuanlan.zhihu.com/p/1895177200665350365

大白话聊一聊Tool、MCP和Agent来龙去脉

2026.1

最近组内开始尝试应用本地AI agent辅助编程。

方案主要是Continue.dev和Cline。

如果要本地部署LLM,两者都可以和Ollama框架配合使用。

https://blog.csdn.net/Hank_dev/article/details/147261418

AI assistant本地部署Continue.dev + Ollama + MCP Server

2016.2

OpenClaw最近爆火。

OpenCode:一个AI编程助手。类似的还有字节的TRAE。

OpenClaw:一个AI agent工具。

QMD(Query Markup Documents)是一个用Rust编写的高性能本地搜索工具,旨在为个人或团队的知识库提供智能化的搜索能力,同时完全保护隐私(本地优先、无需云端服务)。

QMD已被用于替代OpenClaw默认的SQLite进行记忆搜索,可以显著提升Agent在积累大量上下文后的记忆检索能力,解决传统关键词搜索无法找到概念相关,但字面不匹配内容的问题。

两者代表了不同的设计哲学:

- OpenClaw偏重控制力。

- Hermes偏重自进化能力。

https://github.com/OthmanAdi/planning-with-files

Manus原理

https://zhuanlan.zhihu.com/p/1993358891099111451

Manus核心Context技术被人做成了Skills

https://www.zhihu.com/question/1991902608064005627

陈天桥代季峰团队实现30B参数跑出1T性能,这对大模型发展意味着什么?

https://zhuanlan.zhihu.com/p/1994124775983970078

垂直领域Agent落地:为什么我放弃235B/671B,转而训练8B(一)

https://zhuanlan.zhihu.com/p/1994409280238012063

垂直领域Agent落地:为什么我放弃235B/671B,转而训练8B(二)

LLM实战

书籍:

https://jax-ml.github.io/scaling-book/

How to Scale Your Model

实战心得:

https://pytorch.org/blog/high-performance-llama-2/

https://huggingface.co/blog/zh/bloom-inference-optimization

https://huggingface.co/blog/zh/bloom-megatron-deepspeed

训练过程中,损失偶尔会出现毛刺的情况。针对这种情况,Falcon作者会恢复到上一个最新的Checkpoint,并跳过1B Token数据继续训练。作者训练Falcon-180B时出现了9次毛刺。

Google训练PaLM模型遇到了同样的问题。针对此种情况,作者会重启训练,并从毛刺之前的100个step开始,跳过200-500个Batch的数据。作者也做了消融实验,发现并不是单个数据的问题,而可能是这连续的一系列Batch数据引起的。

https://mp.weixin.qq.com/s/rLJlaqI2RL7TGUEQyx-QaA

万卡GPU集群实战:探索LLM预训练的挑战

MFU(Model FLOPs Utilization)

\[\text{MFU} = \frac{\text{model FLOPs per iteration}}{\text{GPU单卡算力} \times \text{卡数} \times \text{一次迭代时间}}\]Transformer模型的MFU计算公式:

\[\text{MFU} = \frac{72blsh^2 \left(1 + \frac{s}{6h} + \frac{V}{12hl}\right)}{F \times N \times T}\]- b:批次大小(micro batch size)。

- l:Transformer 层数。

- s:序列长度。

- h:隐藏层维度。

- V:词表大小。

- F:GPU 单卡的峰值算力(FLOPS)。

- N:使用的 GPU 卡数量。

- T:一次迭代时间(秒)。

SOL(Speed of Light):

\[T_{\mathrm{SOL}} = \max\!\left( \frac{\text{Total FLOPs}}{\text{Compute Throughput}}, \frac{\text{Total Fused Bytes}}{\text{Memory Bandwidth}} \right)\]https://docs.swanlab.cn/zh/examples/pretrain_llm.html

从零预训练一个自己的大模型

PS: swanlab的文档库本身也是一个宝库,而且还是中文的。

本人的魔改版本,wiki_zh dataset + Qwen tokenizer + llama 2 model:

https://github.com/antkillerfarm/antkillerfarm_crazy/tree/master/python/ml/huggingface/llm_train.py

在大模型训练过程中,为确保训练的稳定性与有效性,需密切关注多项关键指标以评估训练状态,其中包括但不限于perplexity (PPL)、gradient norm (GNorm)、activation norm、内存占用情况以及Loss scale等参数。

梯度裁剪(Gradient Clipping):作为一种常用的稳定训练手段,通常设定裁剪阈值为1.0,防止梯度过大引发训练不稳定。

Weight Decay(L2正则化):设置合理的权重衰减率,如0.1,有助于防止过拟合,增强模型泛化能力。

特殊层的调整:GLM研究发现,embedding层往往存在较大的梯度异常情况,故需根据实际情况适度调整相关参数。

正常情况下,你输入的<think>对大模型来说其实可以理解为<think>(三个 Token),和系统赋予的真<think>(一个 Token)是两码事,模型不会混淆。

<|im_start|>和<think>这样的特殊Token只能由系统注入。

https://www.zhihu.com/question/2038402853274915914

为什么Deepseek在输入<think 后会匹配到疑似其他对话?

https://blog.csdn.net/v_JULY_v/article/details/132178447

七月论文审稿GPT第1版:通过3万多篇paper和10多万的review数据微调RWKV

https://blog.csdn.net/v_JULY_v/article/details/134183799

七月论文审稿GPT第2版:用一万多条paper-review数据微调LLaMA2 7B最终反超GPT4

https://blog.csdn.net/v_JULY_v/article/details/131552592

基于LangChain+LLM的本地知识库问答:从企业单文档问答到批量文档问答

https://wandb.ai/ai2-llm/OLMo-7B/reports/OLMo-7B–Vmlldzo2NzQyMzk5

这个网页收录了作者训练LLM时,各项指标的变化曲线。

VLM

https://zhuanlan.zhihu.com/p/702811733

Vision-Language Models (VLMs)多模态大模型一年多的进展与思考-2406

您的打赏,是对我的鼓励